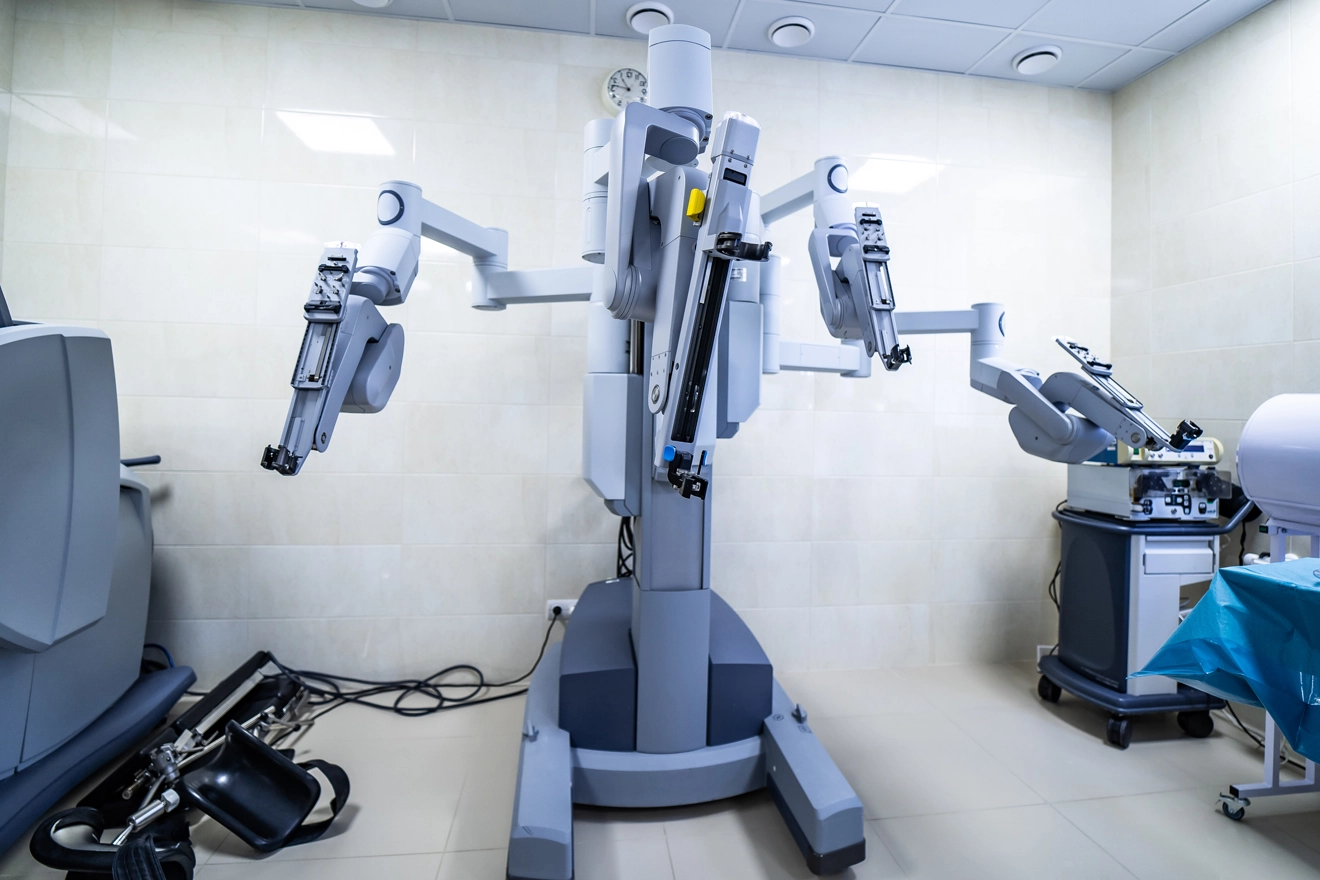

Postęp technologiczny stanowi obecnie integralną część opieki zdrowotnej, a algorytmy sztucznej inteligencji (AI) wraz z innymi aplikacjami opartymi na AI wspierają pracowników służby zdrowia w warunkach klinicznych. Oparte na AI i Machine Learning ML) oprogramowanie jako wyrób medyczny (SaMD) pomaga lekarzom w podejmowaniu decyzji dotyczących lepszej opieki nad pacjentami. Ministerstwo Bezpieczeństwa Żywności i Leków (MFDS) Korei Południowej opracowało wytyczne dotyczące regulacji i monitorowania stosowania wyroby medyczne opartych na sztucznej inteligencji i dużych zbiorach danych. Wytyczne te podkreślają kryteria identyfikacji i klasyfikacji oprogramowania SaMD opartego na sztucznej inteligencji, kwestie, które należy wziąć pod uwagę podczas ich oceny, oraz proces zatwierdzania.

Według MFDS to, czy oprogramowanie AI jest wyrobem medycznym, zależy od jego przeznaczenia, zagrożeń, jakie może powodować, gdy nie działa zgodnie z przeznaczeniem, oraz tego, czy oprogramowanie gwarantuje kliniczną ocenę lekarza. Ponadto MFDS określa również, które oprogramowanie medyczne można zaliczyć do kategorii wyroby medyczne które nie. Oto krótkie porównanie.

Oprogramowanie medyczne należące do kategorii urządzeń medycznych | Oprogramowanie medyczne, które nie należy do kategorii wyrobów medycznych |

|

|

W Korei Południowej kryteria klasyfikacji algorytmów sztucznej inteligencji są zgodne z klasyfikacją urządzeń medycznych i są podzielone na cztery (04) klasy ryzyka. Producenci muszą przedstawić specyfikacje techniczne, w tym informacje na temat środowiska operacyjnego serwera w chmurze, rodzaju usługi w chmurze, standardu bezpieczeństwa itp. Specyfikacje techniczne są zatwierdzane na podstawie czułości, swoistości, pozytywnej wartości predykcyjnej, negatywnej wartości predykcyjnej, krzywej charakterystyki operacyjnej odbiornika (ROC) i obszaru pod krzywą (AUC) oprogramowania urządzenia.

Producenci są również zobowiązani do przedłożenia "Dokumentu zasad działania" określającego algorytm diagnostyczny i wyjaśnienie technologii przetwarzania w chmurze zastosowanej w urządzeniu. Producenci muszą również przedłożyć "Raport z weryfikacji i walidacji oprogramowania" podkreślający informacje dotyczące gromadzenia danych testowych, metodę testowania i standardy testowania. W przypadkach, gdy informacje są przesyłane za pośrednictwem technologii przetwarzania w chmurze, producenci muszą zapewnić prywatność danych poprzez ustanowienie środków, takich jak kontrola dostępu do serwera, uwierzytelnianie użytkowników i szyfrowanie w celu przesyłania i zapisywania informacji medycznych.

Producenci urządzeń medycznych wykorzystujących sztuczną inteligencję muszą wykazać, że ich urządzenia nie mają żadnych luk w cyberbezpieczeństwie. Producenci muszą przedłożyć raport „Weryfikacja i walidacja oprogramowania”. Raport musi zawierać proces testowania i weryfikacji wymagań dotyczących cyberbezpieczeństwa, wyniki testów oraz wyniki ponownych testów w przypadku zmiany oprogramowania podczas testowania i weryfikacji. Producenci muszą przedłożyć dokumenty dotyczące „zarządzania ryzykiem cyberbezpieczeństwa” w celu rejestrowania działań związanych z zarządzaniem ryzykiem oraz minimalizowania i zapobiegania potencjalnym szkodom poprzez identyfikację zagrożeń związanych z cyberbezpieczeństwem w całym cyklu życia wyroby medyczne.

W celu walidacji klinicznej urządzeń opartych na sztucznej inteligencji producenci muszą przeprowadzić badanie prospektywne lub retrospektywne. Badania prospektywne obejmują ocenę uczestników badania w odniesieniu do zmian spowodowanych przez wcześniej zdefiniowane czynniki ryzyka przez określony czas. Badania retrospektywne nie obejmują bezpośredniego kontaktu z uczestnikami badania, ale wykorzystują dokumentację medyczną obejmującą obrazy medyczne i parametry życiowe. Walidacja kliniczna jest ważna w celu określenia odpowiedniej metody badania klinicznego.

Wnioskom dotyczącym algorytmów bez urządzeń referencyjnych musi towarzyszyć dokument z badania klinicznego. Jeśli dostępny jest predykat, można odstąpić od badania klinicznego, ale będzie ono wymagało porównania równoważności z zatwierdzonymi predykatami. Urządzenia należy porównać pod kątem

- Przeznaczenie

- Model wykorzystywany w machine learning

- Charakterystyka danych treningowych w dwóch produktach.

- Informacje wejściowe do analizy wskazań

- Niezbędne elementy technologiczne do wdrożenia algorytmu

- Dane treningowe

- Informacje wyjściowe do analizy wskazań

Algorytmy sztucznej inteligencji odgrywają kluczową rolę w podejmowaniu krytycznych decyzji klinicznych i niedokładnej diagnozie, a wynik może okazać się bardziej ryzykowny dla pacjentów. Wysiłki zmierzające do spełnienia wymogów MFDS mogą stanowić wyzwanie dla producenta. Producenci muszą zacząć od starannego zapoznania się z wymaganiami MFDS dla urządzeń opartych na sztucznej inteligencji i zrozumieć obowiązujące wymagania dla danego przypadku użycia przed planowaniem zgłoszenia. Takie podejście wielokrotnie udowodniło, że zmniejsza koszty i ryzyko czasowe związane z niezgodnością.

Co z urządzeniem medycznym opartym na sztucznej inteligencji? Czy jest ono zgodne z południowokoreańskimi przepisami dotyczącymi urządzeń? Rozpocznij ocenę już teraz ze sprawdzonym ekspertem ds. regulacji.