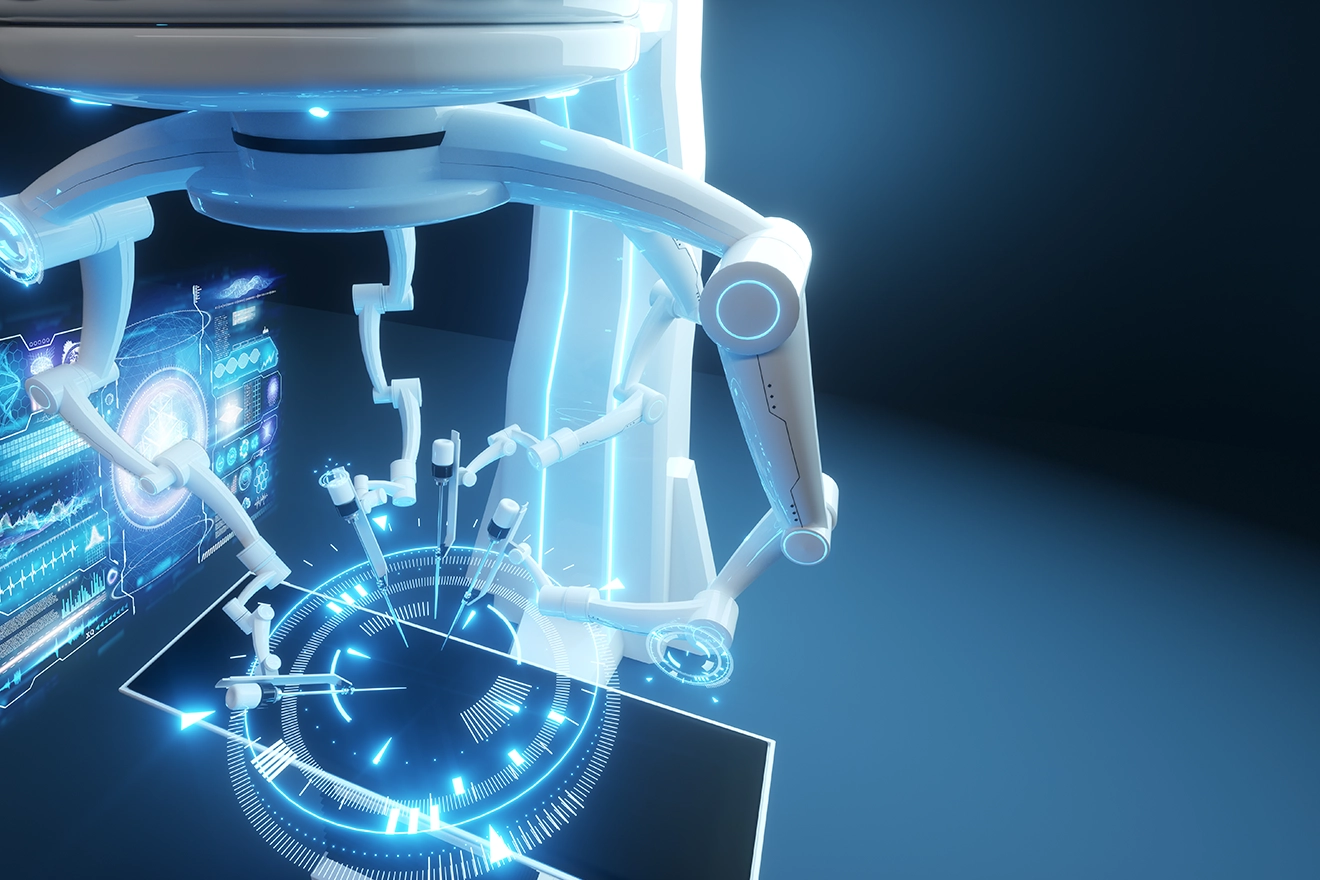

A Inteligência Artificial já não é apenas uma vantagem tecnológica na indústria dos dispositivos médicos - está a tornar-se uma função regulamentada de confiança, responsabilidade e desempenho. A Europa estabeleceu uma fronteira distinta entre o progresso tecnológico e a responsabilidade ao adotar a Lei da Inteligência Artificial da UE formal em 1 de agosto de 2024.

A nova legislação fornece aos fabricantes de dispositivos médicos, especificamente aos que trabalham com Software as a Medical Device SaMD) alimentado por IA, requisitos regulamentares e indicadores de mercado.

O Ato UE sobre a IA: Um novo paradigma regulamentar

A lei estabelece novas normas para as operações de desenvolvimento, avaliação e monitorização da IA no território da União Europeia através das suas medidas abrangentes. Todos os criadores de soluções de IA que procuram entrar no mercado da União Europeia devem compreender que a mensagem relativa à implantação da IA continua a ser clara e concisa. O sistema regulamentar determina que qualquer sistema que afecte o diagnóstico dos cuidados de saúde ou o tratamento dos doentes, ou a saúde, deve ter um estatuto de alto risco.

Compreender o cerne da Lei da IA da UE: Baseada no risco, específica do sector e orientada para o impacto

A Lei da IA da UE integra um modelo de classificação baseado no risco que cria três categorias: Práticas Proibidas, Sistemas de IA de Alto Risco e Sistemas de Risco Limitado. A IA médica enquadra-se quase sempre na categoria de alto risco, particularmente ao abrigo da alínea b) do n.º 1 do artigo 6.º, que classifica qualquer componente de IA de um dispositivo médico que exija a análise de um organismo notificado como sendo de alto risco por defeito.

Os sistemas de IA para diagnóstico, planeamento de terapias, apoio à decisão clínica e monitorização remota - todos se enquadram neste escalão de Alto Risco. Isto inclui aqueles que empregam:

- Modelos Machine Learning ML)

- Algoritmos de aprendizagem profunda

- Redes Neuronais ou Classificadores Estatísticos

- Software de reconhecimento preditivo ou de padrões incorporado em dispositivos médicos

Principais requisitos do fabricante ao abrigo da Lei da IA da UE:

A implementação de mandatos técnicos fundamentais no âmbito de um Sistema de Gestão da Qualidade requer a atenção dos fabricantes para uma conformidade efectiva.

- Gestão do risco (artigo 9.º):

Os fabricantes devem criar e manter estratégias organizadas de gestão do risco da IA, uma vez que estas resolvem a instabilidade do modelo de preconceito algorítmico, bem como as violações do sistema de segurança e os problemas com o preconceito algorítmico. Além disso, nos termos da norma IEC 62304, a classificação da segurança do software é um passo fundamental. Cada item de software deve ser classificado como Classe A, B ou C com base no risco. Esta classificação determina a profundidade das actividades necessárias ao longo do ciclo de vida do software. É importante incorporar esta classificação nas fases iniciais de conceção e avaliação de riscos. - Governação de dados (artigo 10.º):

Os fabricantes devem selecionar conjuntos de dados de elevada qualidade, juntamente com amostras representativas e informações anotáveis e não tendenciosas para a seleção de conjuntos de dados, entre outros critérios. - Documentação técnica (artigo 11.º):

Organizar um sistema de documentação ativa para apresentar informações completas sobre a estrutura do sistema de IA, juntamente com medições de desempenho e controlos operacionais e componentes de segurança. De acordo com a norma IEC 82304, deve também ser incluída uma Especificação de Requisitos de Segurança do Produto durante a fase de finalização dos requisitos. Este documento define as necessidades essenciais de segurança, proteção e usabilidade e deve ser revisto como um elemento essencial. - Transparência e explicabilidade (artigo 13.º):

Os utilizadores precisam de receber descrições acessíveis da lógica do sistema de IA que expliquem as capacidades operacionais e os limites do sistema, juntamente com a justificação dos seus processos de tomada de decisão. - Supervisão humana (artigo 14.º):

Os profissionais who recebem formação podem utilizar procedimentos autorizados para evitar danos automatizados nas decisões, mantendo o controlo operacional através desses procedimentos. - Registo e rastreabilidade (artigo 12.º):

As entradas do sistema, juntamente com as saídas e os registos da árvore de decisão, devem ser registados na íntegra e, especialmente, durante a implantação clínica para actividades de vigilância pós-comercialização. - Monitorização pós-comercialização (artigo 72.º):

Devem ser implementadas diretrizes para medir continuamente o desempenho do sistema de IA após a sua implementação comercial. O sistema deve utilizar análises reais do desempenho operacional efetivo para integrar o feedback do utilizador e otimizar os sistemas de controlo de riscos. Além disso, a norma IEC 62304 exige um plano de manutenção de software documentado. Este plano deve definir como as anomalias, correções e atualizações de software pós-lançamento são gerenciadas e validadas. As actividades de manutenção devem estar alinhadas com as práticas de monitorização a longo prazo. - Marcação e registo CE (artigo 17.º):

Ao aplicar a marca CE a dispositivos médicos de IA, estes têm de cumprir os requisitos do Regulamento relativo aos dispositivos médicos (MDR 2017/745) ou do Regulamento relativo ao diagnóstico in vitro (IVDR 2017/746) e da Lei da IA da UE.

Mais do que regulamentação: Uma revisão do ciclo de vida

A transformação vai para além dos requisitos regulamentares porque exige uma reformulação completa do processo de desenvolvimento do ciclo de vida do sistema de IA, desde a criação até à manutenção. A excelência do desempenho técnico dá lugar a uma supervisão regulamentar permanente e ao controlo das normas éticas.

Incorporando os princípios da IEC 62304, é necessário um processo formal de resolução de problemas de software ao longo de todo o ciclo de vida. Os fabricantes devem definir procedimentos para identificar, documentar, analisar e resolver anomalias de software. Isto deve ser incorporado em cada porta de qualidade, especialmente após a verificação.

A gestão do SOUP (Software de Proveniência Desconhecida) também é obrigatória. Cada componente SOUP deve ser identificado, avaliado quanto ao risco e controlado através de revisões da documentação de conceção e arquitetura. Isto garante que as dependências externas são seguras e geridas de forma adequada.

Além disso, a norma IEC 82304 enfatiza os processos definidos para a instalação, gestão da configuração e desativação do sistema. Estes processos devem ser validados e documentados durante a fase final de desenvolvimento, antes do lançamento comercial. Um processo de mitigação do risco de cibersegurança deve também ser integrado no SDLC e verificado em cada fase do ciclo de vida.

Adoção da IA na Europa: O cenário de 2024

Os dados remotos do relatório do Eurostat de 2024 sobre a utilização da IA nas empresas europeias mostram um padrão crescente de implementação da IA nas empresas europeias em 2024:

- 41,2% das grandes empresas utilizam atualmente a inteligência artificial.

- 34,1% das empresas beneficiam de operações de marketing e vendas.

- 27,5% de benefício nas operações comerciais.

- 6,1% de benefício na logística.

O fosso na adoção da IA é evidente entre as grandes e as pequenas empresas:

- A tecnologia de IA é aplicada à segurança das TIC por 46,4% das grandes empresas, mas apenas 17,2% das pequenas empresas a utilizam para este fim.

- Uma percentagem significativa de 34,7% das grandes empresas utiliza a IA nos processos de produção, em comparação com as empresas mais pequenas, com 21,6% de utilização da IA.

- A adoção industrial da inteligência artificial enfrenta vantagens e dificuldades, uma vez que 13,5% das empresas da UE aplicam atualmente tecnologias de IA.

Estes números demonstram uma dupla realidade - por um lado, a IA já está a remodelar funções empresariais críticas; por outro, existe uma lacuna substancial na adoção em escala, particularmente em domínios regulamentados como os cuidados de saúde, onde a confiança e a segurança são pré-requisitos para o crescimento.

A Europa não se limita a regulamentar - está a investir na expansão de uma IA fiável

Ao contrário das anteriores vagas de transformação digital, a abordagem da UE à IA combina política com investimento proactivo.

Um relatório do Europarl reconhece que a inovação em matéria de IA deve ser acelerada, mas não à custa da segurança dos doentes ou do controlo ético.

- 1,8 mil milhões de dólares de apoio financeiro para as empresas europeias em fase de arranque no domínio da IA (2023)

- A UE recebe apenas 6% do capital de risco global para a IA, com investimentos quatro vezes inferiores aos dos EUA.

As iniciativas de financiamento incluem:

- Programa Europa Digital: 1,3 mil milhões de euros (2025-2027) para instalações de ensaio e polos de desenvolvimento de competências.

- InvestAI: Parte da estratégia da Década Digital, com o objetivo de reunir 200 mil milhões de euros para:

- Fábricas de IA

- Serviços em nuvem

- Redes de inovação transfronteiriças

As instituições da UE criam um ambiente de apoio através de alterações regulamentares que permitem sistemas de IA éticos, clinicamente fiáveis e escaláveis para os fabricantes de SaMD .

O que isto significa para as empresas de dispositivos médicos

Os regulamentos da Lei da IA da UE, juntamente com as suas implicações comerciais essenciais, apresentam dois pontos principais que os fabricantes de dispositivos médicos devem abordar.

Estes pontos são ainda mais reforçados quando alinhados com as normas IEC 62304 e IEC 82304, que fornecem estrutura, rigor de classificação, continuidade pós-lançamento e governação da segurança ao longo do ciclo de vida do software.

Preparar a conformidade antes da entrada no mercado

- Realizar uma análise das lacunas da Lei da IA

- Atualizar ficheiros técnicos, RMFs e SOPs

- Incorporar mecanismos de rastreabilidade desde a fase de conceção

- Envolver-se precocemente com os Organismos Notificados para a pré-avaliação

- Planear a vigilância pós-comercialização a longo prazo com ciclos de feedback

Converter a conformidade em vantagem competitiva

- As empresas que lideram a conformidade também lideram a confiança e a quota de mercado

- Construir o SGQ com o alinhamento da Lei da IA desde a fase de conceção

- Posicionar a transparência e a auditabilidade como factores de diferenciação do mercado

- Tirar partido da conformidade com a marca CE + IA como um distintivo de confiança

Perguntas mais frequentes sobre a Lei da IA da UE relativa aos dispositivos médicos

Para ajudar os fabricantes de dispositivos médicos a navegar no cenário de conformidade em evolução, eis algumas das perguntas mais frequentes:

- O que é a Lei de IA da UE e qual o seu impacto nos fabricantes de dispositivos médicos?

A Lei de IA da UE é o primeiro quadro regulamentar abrangente de IA do mundo. Impõe requisitos obrigatórios para a gestão de riscos, governação de dados, supervisão humana e vigilância pós-comercialização, especialmente para a IA médica de alto risco, como ferramentas de diagnóstico e software de apoio à decisão clínica. - Quais sistemas de IA em dispositivos médicos são classificados como de alto risco pela Lei de IA da UE?

Qualquer sistema de IA utilizado no diagnóstico, planeamento terapêutico ou monitorização de pacientes é considerado de alto risco. Isso inclui SaMD machine learning, modelos de aprendizagem profunda e ferramentas de IA que influenciam decisões ou resultados de saúde. - Quais são os principais requisitos de conformidade para dispositivos médicos alimentados por IA ao abrigo da Lei da IA da UE?

Os fabricantes devem garantir:

- Rastreabilidade de entradas e saídas

- Qualidade e governação robustas dos dados

- Mecanismos de supervisão humana

- Documentação técnica completa

- Marcação CE ao abrigo das normas MDR/IVDR e da Lei da IA Como é que a Lei da IA da UE se relaciona com o RDM (2017/745) e o RIV (2017/746)?

O AI Act da UE baseia-se no MDR/IVDR, estabelecendo requisitos específicos para a IA, como a explicabilidade, a transparência dos algoritmos e os controlos de risco. Todos os dispositivos alimentados por IA devem cumprir uma dupla conformidade - as regras tradicionais dos dispositivos médicos e as novas normas de IA.

Os líderes de mercado abordam a Lei da IA da UE não como um obstáculo, mas como um modelo para a criação de tecnologias médicas fiáveis e de elevado desempenho. Adotam a conformidade ao nível da arquitetura e utilizam-na para informar a estratégia, o marketing e o posicionamento da marca.

As empresas de dispositivos médicos devem incorporar a prontidão da Lei de IA em todo o seu ecossistema de produtos e conformidade para obter uma vantagem competitiva. us hoje para alinhar a sua inovação com a conformidade e transformar a preparação regulamentar numa vantagem competitiva.